Komputery doskonale radzą sobie z pobieraniem modelu 3D i renderowaniem go na ekranie 2D. Do tej pory jednak nie były w stanie wykonać ze zdjęcia 2D modelu 3D. A przynajmniej nie takiego, który oddawałby realny kształt. Jednak dzięki sztucznej inteligencji jest to teraz możliwe. Naukowcy z Nvidii stworzyli strukturę renderowania, która wykorzystuje AI do pobierania informacji 2D i dokładnego przekształcenia ich w obiekt 3D.

Modele 3D ze zwykłych zdjęć

System ten nosi nazwę DIB-R. Jest to skrót od differentiable interpolation-based renderer. Zespół zaprezentuje swoje dzieło na corocznej konferencji Neural Information Processing Systems w Vancouver, która odbędzie się w tym tygodniu. Zasadniczo struktura robi coś zupełnie przeciwnego do tego, co zazwyczaj robią jednostki GPU. Analizuje obraz, a następnie tworzy obiekt 3D o wysokiej wierności. Zachowuje przy tym kształt, teksturę, kolor i oświetlenie. Architektura kodera-dekodera zaczyna się od sfery wielokąta i morfizuje ją przy użyciu podanych informacji w obrazie 2D. Proces ten zajmuje tylko jedną dziesiątą sekundy. Jednak zanim to nastąpi, sieć neuronowa potrzebuje dwóch dni na przeszkolenie przy użyciu jednego procesora graficznego Nvidia V100.

Zobacz też: Harmony OS na smartfonach już w przyszłym roku – to oficjalne

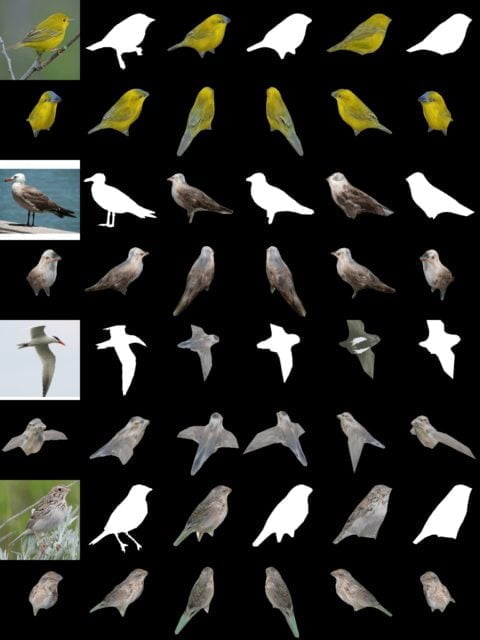

Nvidia twierdzi, że szkolenie z wykorzystaniem innych układów GPU trwałoby kilka tygodni. Po przeanalizowaniu kilku zestawów danych zawierających zdjęcia ptaków DIB-R był w stanie precyzyjnie tworzyć modele 3D po otrzymaniu pojedynczego obrazu. Podczas gdy ptaki były przedmiotem eksperymentu, współautor pracy badawczej na ten temat, Jun Gao powiedział, że system może renderować dowolny obraz 2D do modelu 3D.

Jest to w zasadzie pierwszy raz w historii, kiedy można wykonać prawie każdy obraz 2D i przewidzieć odpowiednie właściwości 3D.

— powiedział Gao.

Naukowcy wierzą, że system ten może być wykorzystywany w celu poprawy bezpieczeństwa i dokładności robotów autonomicznych podczas pracy w środowisku. Zrozumienie trójwymiarowości rzeczy wokół nich pozwoli robotom na lepszą nawigację, a także manipulowanie obiektami, które mają za zadanie obsługiwać.

Źródło: TechSpot