Deepfake to technologia, która coraz mocniej irytuje korporacje, celebrytów, ale też i zwykłych ludzi. Daleko szukać nie trzeba, bo wygenerowanie nagich zdjęć nie ominęło nawet piosenkarki Taylor Swift, mimo iż ta dla odmiany posiada środki finansowe, by walczyć w sądach z oszustami wykorzystującymi AI. Większość ludzi jednak takich zdolności operacyjnych nie ma, a skala procederu wyłącznie będzie rosnąć.

Liczba ataków deepfake rośnie — Spis treści

Jak najprościej zrozumieć czym jest deepfake?

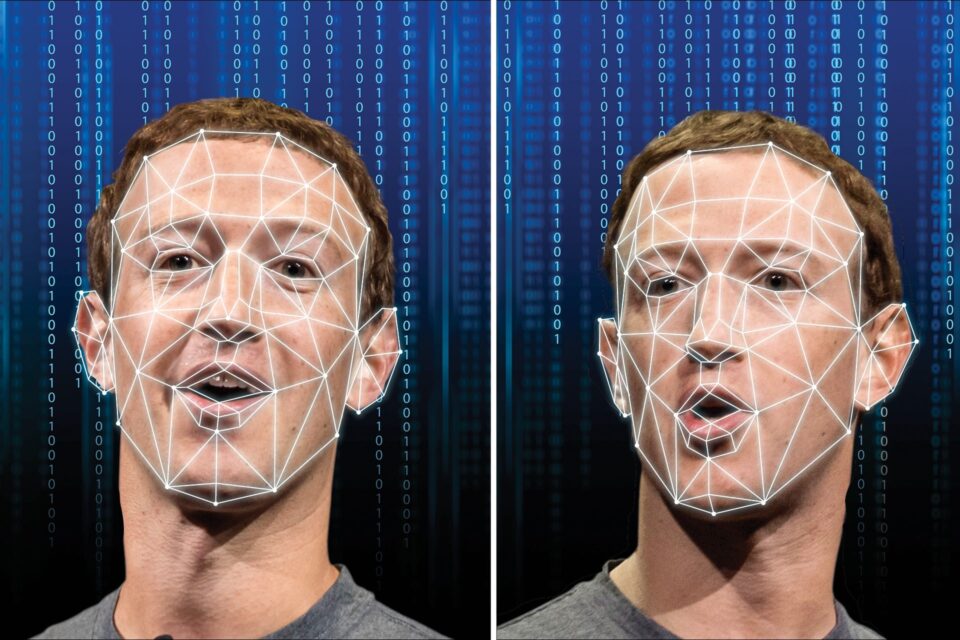

Deepfake to technologia pozwalająca nałożyć twarz jednej osoby na ciało dublera. Bardzo chętnie jest wykorzystywana w filmach, gdzie trzeba np. nagrać krótką scenę z użyciem bohatera granego wcześniej przez nieżyjącego lub podstarzałego już aktora. Proces ten wykorzystuje twarz, głos i mimikę postaci, dzięki którym mamy wrażenie, że odtwarzana postać jest rzeczywista.

Problem polega jednak na tym, że pozytywne zastosowania są niewidoczne wręcz w morzu problemów. Technologia ta jest bardzo często wykorzystywana do tworzenia filmów dla dorosłych zawierających wizerunki celebrytów. Zdarzają się też przypadki, gdzie takie nagrania są tworzone ze zwykłymi ludźmi, a następnie są używane do szantażu.

Jaka jest szansa, że rodzina, znajomi, współpracownicy i przełożeni uwierzą nam, że nieprzyjemne nagranie jest deepfake? Ten niewyobrażalny stres i świadomość kłopotów sprawia, że niestety to jedno z najlepszych narzędzi do szantażu, a technologia przecież nie jest jeszcze doskonała. Sztuczna inteligencja stale jest trenowana na autentycznych materiałach, by móc jeszcze lepiej odtwarzać zachowania ludzi. Przekręty z deepfake potrafią sprawić, że pracownicy korporacji bez zawahania się przelewają grube miliony dolarów na konta oszustów.

W poprzednim roku liczba ataków deepfake wzrosła o 703%

Przestępcy coraz częściej wykorzystują narzędzia sztucznej inteligencji, aby wprowadzać ludzi w błąd za pomocą fałszywych zdjęć i nagrań. iProov to brytyjska firma opracowująca rozwiązania do weryfikacji pracowników zdalnych, która przygotowała raport dotyczący m.in. użycia deepfake wśród przestępców. Wskazał on, że w 2023 r. odbyło się ok. 703% więcej ataków z wykorzystaniem technologii deepfake niż w 2022 r.

Najchętniej wykorzystywanymi narzędziami były SwapFace, DeepFaceLive oraz Swapstream. Programy te radzą sobie doskonale z podmianą twarzy na żywo i nawet przechodzą prawidłowo testy bezpieczeństwa, takie jak poruszanie głową czy też skoncentrowane spojrzenia w kamerkę internetową. Działają one na podstawie wirtualnej kamerki tak jak VTuberzy. Bardziej zaawansowani użytkownicy używają też emulatorów, które ukrywają istnienie wirtualnej kamerki w systemie. Tylko że tym razem, nie służy to do zabawy z widzami, a do popełniania oszustw i wyłudzeń.

Zdjęcie otwierające: Biuro Prasowe Orange

Część odnośników to linki afiliacyjne lub linki do ofert naszych partnerów. Po kliknięciu możesz zapoznać się z ceną i dostępnością wybranego przez nas produktu – nie ponosisz żadnych kosztów, a jednocześnie wspierasz niezależność zespołu redakcyjnego.