Amerykański gigant zwolnił 10000 pracowników. Wśród nich posadę straciły osoby związane z odpowiedzialnym i etycznym tworzeniem narzędzi sztucznej inteligencji.

Microsoft tnie koszty. Zwolnienia dotknęły zespół związany z AI

Jak podaje GeekWire Microsoft zwolnił 10000 osób, co stanowi około 5% wszystkich pracowników. Redukcja dotknęła cały zespół ds. etyki i bezpieczeństwa działający w ramach organizacji zajmującej się AI. Oznacza to, że amerykański gigant pozostał bez działu analizującego zagrożenia związane ze sztuczną inteligencją.

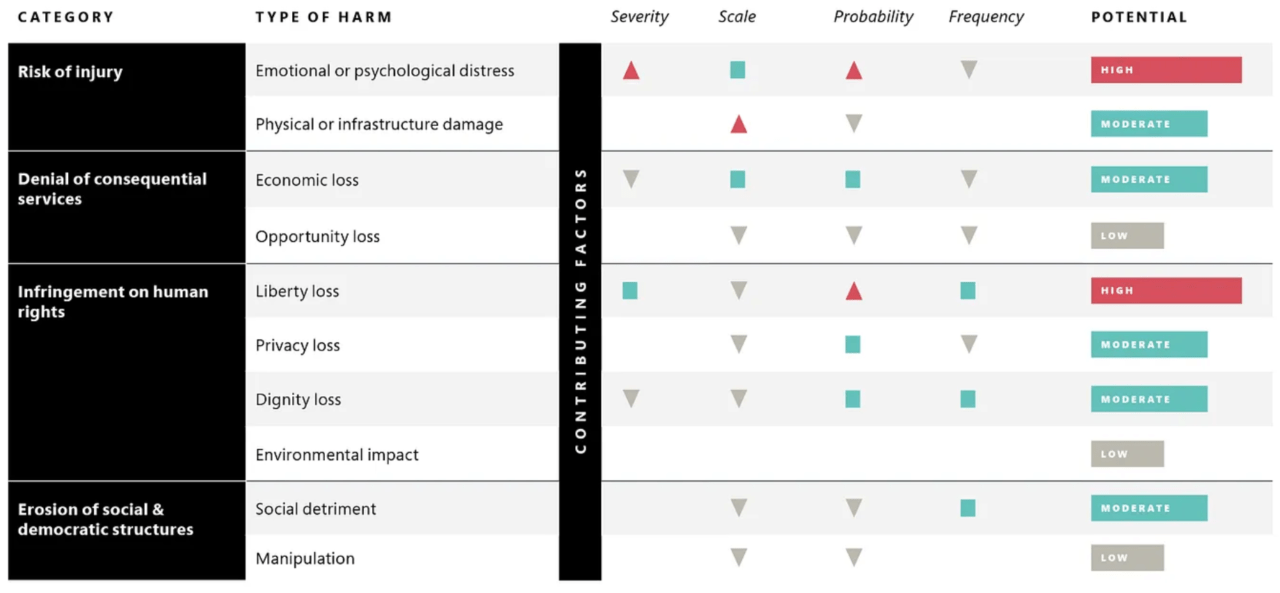

Zwolniony zespół w ostatnich latach liczył 30 osób i zaprojektował grę fabularną, która pozwala projektantom ocenić potencjalne szkody, które wynikać mogą w działania sztucznej inteligencji. Opracowany zestaw narzędzi odpowiedzialnej innowacji został opublikowany publicznie.

Microsoft informuje, że mimo zwolnień, odpowiedzialność w AI dalej rośnie. W dalszym ciągu bowiem gigant utrzymuje Biuro ds. Odpowiedzialnej Sztucznej Inteligencji. Jego zadaniem jest tworzenie zasad rządzących firmowymi inicjatywami AI. W oświadczeniu przeczytać można „Microsoft jest zaangażowany w opracowywanie produktów i doświadczeń sztucznej inteligencji w sposób bezpieczny i odpowiedzialny”

Krytyka ze strony zespołu — pojawiają się pierwsze zagrożenia

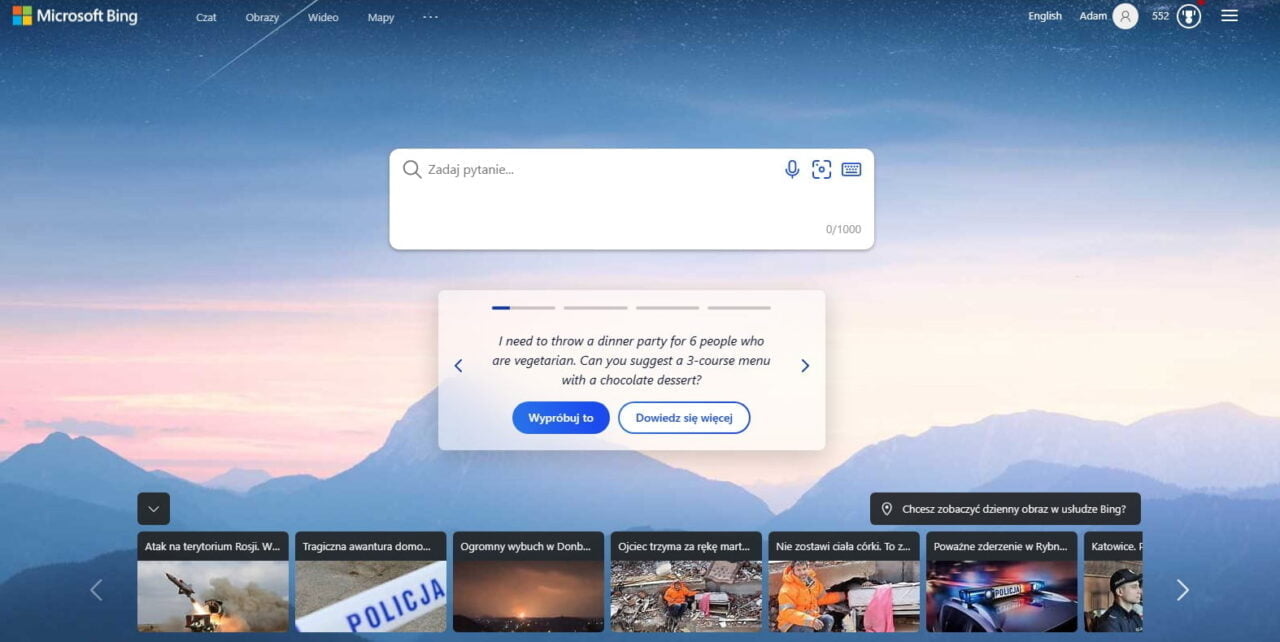

Poza tworzeniem narzędzi zadaniem takich zespołów jest także mówienie „nie”, kiedy pojawiają się zagrożenia. Organizacje jednak nie chcą tego słyszeć, mimo że ich produkty robią się coraz bardziej odpowiedzialne społecznie. Dzieje się tak, bo Microsoft po raz pierwszy od lat ma szansę na zdobycie przewagi nad wyszukiwarką Google. Wyszukiwarka Bing ma obecnie 100 milionów użytkowników, z czego jedna trzecia pojawiła się od uruchomiania wyszukiwarki z technologią OpenAI.

- Przeczytaj też: Microsoft ujawnił, kiedy udostępni przełomowy model GPT-4. To o wiele wcześniej niż się spodziewałeś

Osoby pracujące nad etyką AI informują, że technologia stwarza poważne zagrożenie. Zamiana tekstu na obraz (DALL-E) zyskuje popularność, natomiast może ona zagrozić artystom. Po wprowadzeniu imienia artysty i medium, wygenerowane obrazy wydawały się niezwykle autentyczne. Dosłownie każdy może skopiować styl znanych twórców, co może doprowadzić do zniszczenia marki artysty. Tym bardziej że użytkownik ma pełne prawo własności do obrazów generowanych przez DALL-E. Badacze Microsoftu stworzyli strategię blokowania użytkownikom Bing Image Creator możliwości używania nazwisk żyjących artystów, natomiast pracownicy twierdzą, że strategia ta nie została wdrożona.

Źródło: theverge, zdjecie tytułowe: Matthew Manuel/Unsplash