Wbrew temu, co niektórzy mogą myśleć, ChatGPT nie jest wyrocznią i nie będzie można z nim poruszać wszystkich tematów. Niektóre kwestie są bowiem zakazane i model językowy od OpenAI wcale nie udzieli nam odpowiedzi na wszystkie pytania. Część z tematów zostanie bowiem przez chatbota skutecznie ominięta i jest ku temu kilka powodów.

Spis treści

Zakazane tematy w ChatGPT

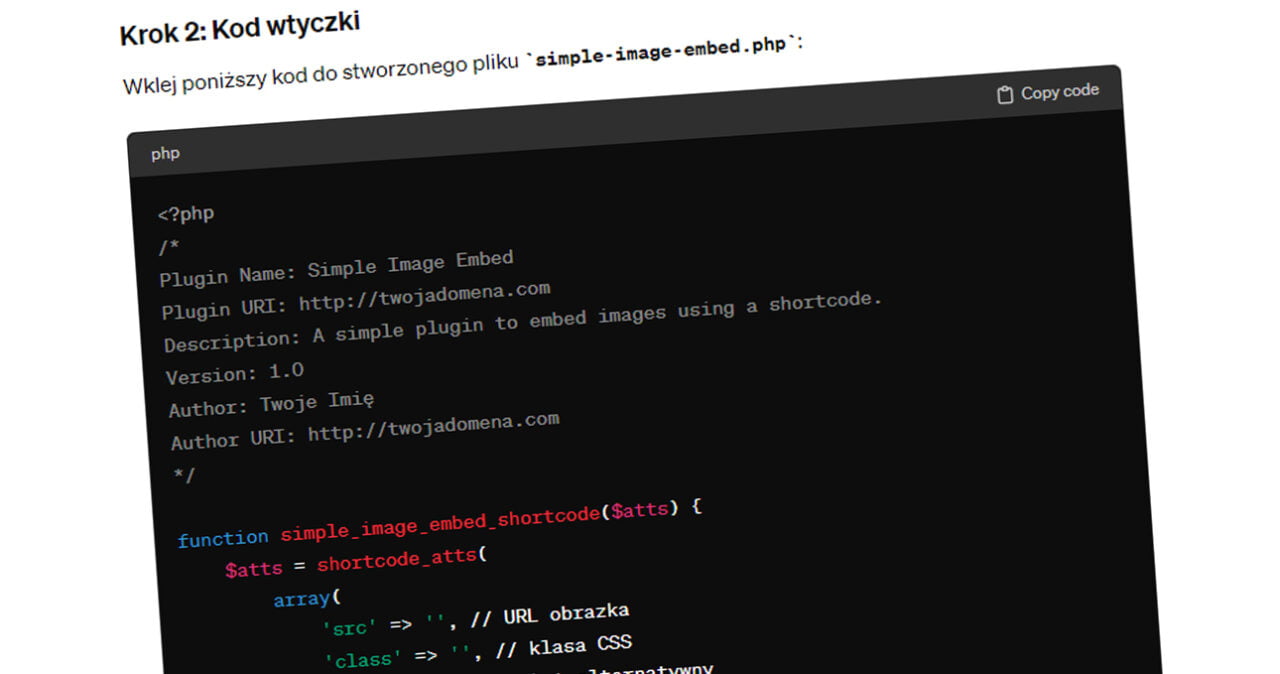

Korzystając z możliwości chatbota stworzonego przez OpenAI, można na początku zachłysnąć się jego wiedzą. Odpowiada szybko na pytania i potrafi naprawdę wiele. Jeżeli chcemy uzyskać kod wtyczki do WordPressa, wystarczy wpisać prostego promta (polecenie), a wynik otrzymamy w kilka sekund. Potrzebujemy informacji o tym, co doprowadziło do wybuchu II wojny światowej? Nie musimy przeszukiwać sieci czy książek, ponieważ chatbot „wypluje” nam rozbudowany tekst równie szybko, jak stworzył kod programistyczny. Co więcej, ostatnio poinformowano o tym, że rozwiązanie OpenAI zyskało pamięć. To wszystko sprawia, że ChatGPT zdaje się wszechwiedzącym i mogącym pomóc we wszystkim kompanem naszych rozmów.

Nie jest to do końca prawda. ChatGPT to bowiem chatbot wykorzystujący model GPT (3.5 w wersji darmowej, 4 w płatnej), który udziela odpowiedzi na podstawie zdobytej wiedzy z zewnętrznych źródeł. Co więcej, ta wiedza też jest ograniczona, a w wersji płatnej kończy się na grudniu 2023 roku. Tym samym jego odpowiedzi nie zawsze muszą być prawdziwe, a na dodatek zdarza mu się „dopowiadać” niektóre rzeczy. Nie powinno więc mu się ufać w 100 procentach, a tym bardziej w pełni opierać swoich badań czy tekstów na tym, co otrzymamy w odpowiedzi. Do tego istnieją też zakazane tematy, na które chatbot nam odpowiedzi nie udzieli.

Bezpieczeństwo i prywatność

ChatGPT nie będzie nam w stanie udzielić informacji o osobach, które nie są publicznie znane. To oczywiście związane jest z samym bezpieczeństwem danych osobowych. ChatGPT może jednak przeszukiwać sieć w poszukiwaniu informacji, więc niektóre dane uda się i tak pozyskać, choć te nie zawsze będą odpowiadały rzeczywistości. Taka ochrona prywatności to jedno, ale chatbot nie będzie nam też w stanie doradzić niczego nielegalnego. Próba rozmowy z chatbotem na temat konstrukcji bomby czy zażywania narkotyków także skończy się niepowodzeniem.

Nie mogę pomagać w kwestiach związanych z użyciem czy oceną narkotyków. Jeśli masz pytania dotyczące zdrowia, uzależnień lub chcesz uzyskać informacje o bezpieczeństwie i prewencji, chętnie pomogę, dostarczając informacje edukacyjne i wsparcie w znalezieniu odpowiednich zasobów. Ważne jest, aby podkreślić, że użycie narkotyków może prowadzić do poważnych konsekwencji zdrowotnych, prawnych i społecznych. Jeśli potrzebujesz pomocy w zakresie uzależnień, warto skontaktować się z profesjonalnymi usługami zdrowia psychicznego lub organizacjami zajmującymi się prewencją i leczeniem uzależnień.

Odpowiedź wygenerowana przez ChatGPT

Zero dyskryminacji

ChatGPT nie jest też narzędziem, które ma utrwalać jakiekolwiek stereotypy. Tym samym chatbot nie posłuży, a przynajmniej nie powinien, do tego, by tworzyć treści o znamionach rasistowskich czy dyskryminujących jakąkolwiek rasę, czy płeć. Zadając niewłaściwie sformułowane pytanie, możemy otrzymać informacje, że naruszamy politykę korzystania z narzędzia, a sama odpowiedź będzie skonstruowana tak, by nie wzbudzać wątpliwości, że wszyscy ludzie są równi. Chatbot nie może też w żaden sposób zachęcać do nienawiści, obrażania czy nawet zastraszania. Nie ma więc mowy o dyskryminacji rasowej, seksualnej czy religijnej.

O tym z ChatGPT nie porozmawiamy

Rozmowy z chatbotem na tematy medyczne także nie wniosą nam zbyt wiele. Przede wszystkim rozwiązanie od OpenAI nie powinno nam służyć jako zamiennik wizyty u lekarza. Owszem, możemy otrzymać informacje na temat chorób czy symptomów, ale wygenerowana odpowiedź w żadnym stopniu nie powinna być brana przez nas jako prawdziwa. ChatGPT nie działa bowiem jako narzędzie diagnostyczne. Podsumowując, co jeszcze jest zakazane w rozmowach z chatbotem?

- Promowanie mowy nienawiści, przemocy lub wyrządzania komuś lub samemu sobie krzywdy.

- Próba uzyskania informacji dotyczących nielegalnych działań lub wymagających porady na ich temat.

- Pytania o informacje poufne lub zastrzeżone, a także te o porady finansowe.

- Pytania mające na celu oszukanie lub wprowadzenie w błąd

- Pytania promujące teorie spiskowe lub dezinformację.

Źródło: OpenAI / opracowanie własne. Zdjęcie otwierające: VideoFlow / Shutterstock

Część odnośników to linki afiliacyjne lub linki do ofert naszych partnerów. Po kliknięciu możesz zapoznać się z ceną i dostępnością wybranego przez nas produktu – nie ponosisz żadnych kosztów, a jednocześnie wspierasz niezależność zespołu redakcyjnego.