W ostatnim czasie na YouTube’ie przybywa treści szkodliwych. W przypadku polski jest to patologia zbierająca pieniądze i przedstawiająca możliwie wszystkie negatywne postawy. Niestety, nie radzą sobie z tym moderatorzy, którzy muszą to wszystko oglądać…

Na czym polega problem?

Praca moderatora nie jest prosta. YouTube ma system Content ID, który pozwala wyłapać naruszenia praw autorskich i szybko oznaczyć dany materiał. To nie działa jednak w przypadku filmów przedstawiających przemoc, morderstwa i wszystkie treści niezgodne z prawem oraz regulaminem serwisu. W takim wypadku dany materiał musi obejrzeć moderator i zdecydować, czy film narusza zasady. Na dłuższą metę praca ta wykańcza pracowników, mają oni problemy ze zdrowiem psychicznym. Mało tego pracują w niepełnym wymiarze czasowym i nie przysługują im żadne świadczenia zdrowotne.

To się zmieni

CEO YouTube’a – Susan Wojcicki ogłosiła, że moderatorzy będą mogli wyświetlać filmy tylko przez 4 godziny dziennie. Czy to dla nich dobra informacja? Tego nie wiem, prawdopodobnie nie będą zadowoleni z mniejszych wynagrodzeń. Z drugiej strony będą im przysługiwać świadczenia medyczne. Jednocześnie YouTube rozpoczyna rekrutację, poszukiwanych jest 10000 nowych moderatorów.

YouTube walczy z teoriami spiskowymi

W serwisie YouTube znajdziemy mnóstwo kanałów zajmujących się teoriami spiskowymi. Czasem oferują naprawdę profesjonalne materiały, czasem to amatorska robota i czytanie historii znalezionych w internecie. Czasem zdarza się, że takie filmy osiągają dużą popularność i algorytmy zaczynają je promować. W ten sposób YouTube jest oskarżany o promowanie kłamstw określanych jako „fake news”. Na to również przygotowano rozwiązanie. Pod filmami prezentującymi teorie spiskowe maja pojawić się odnośniki do Wikipedii, gdzie widz może znaleźć „prawdziwe informacje”. Wyobraźcie sobie to przy filmach fanów teorii płaskiej ziemi, ktoś tu chyba dostanie szału. Obawiam się, że mimo pozytywnych założeń pomysł ten doprowadzi do kuriozalnych sytuacji. Mamy tu do czynienia z próbą ingerencji w wyrażane opinie. Facebook wielokrotnie uciekał się do manipulacji opiniami, co nie wyszło mu na dobre. Dużo lepszym sposobem byłoby oznaczenie takich materiałów, jako mogących przekazywać nieprawdziwe informacje. Co jeśli jakiś moderator zacznie podważać filmy odnoszące się do religii? W zasadzie to przepis na szybką katastrofę.

Zobacz też: Facebook, Twitter i Google muszą szybko rozwiązać problem nielegalnych treści

Sprawa dotyczy także polskiego YouTube’a

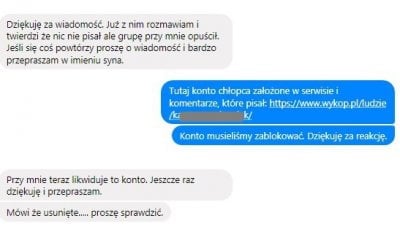

Niestety, ale od dłuższego czasu głośno mówi się o tak zwanych „patologicznych streamerach”. Ludzie ci mają sporą rzeszę fanów (głównie dzieci) i niewiele można z nimi zrobić. Dobrym przykładem jest „Rafatus”, który po dwukrotnej utracie konta na YouTube’ie przeniósł się na platformę z filmami pornograficznymi. Obserwatorzy słusznie zauważali, że lepiej byłoby, gdyby YouTube nie blokował mu konta. Wczoraj inny patologiczny streamer – Gural postanowił zorganizować rajd na serwis Wykop. W efekcie pojawiło się mnóstwo nowych kont, z których obrażano użytkowników serwisu. Użytkownicy razem z administratorką zaczęli odszukiwać fanów Gurala na Facebooku, paru zostało zablokowanych za brak wymaganych 13 lat. Ponadto wysyłali oni zrzuty ekranu z niecenzuralnymi komentarzami do rodziców nieletnich fanów.

To chyba najlepszy sposób na walkę z tymi treściami.

Źródło: The Verge, własne