Tworzenie gier to niewiarygodnie czasochłonny i kosztowny proces, w którym budżety na sztukę i animację często pochłaniają pokaźną część rezerw finansowych zespołu. Wiarygodna animacja twarzy jest szczególnie istotna w przypadku tytułów o dużej liczbie dialogów i jest wyzwaniem w przypadku różnych wersji językowych gry. Dlatego też Nvidia pracuje nad narzędziem opartym na sztucznej inteligencji, które może odczytywać pliki audio i tworzyć dopasowane animacje twarzy w czasie rzeczywistym, Z tego też powodu nie jest wymagany mocap.

Nvidia Audio2Face

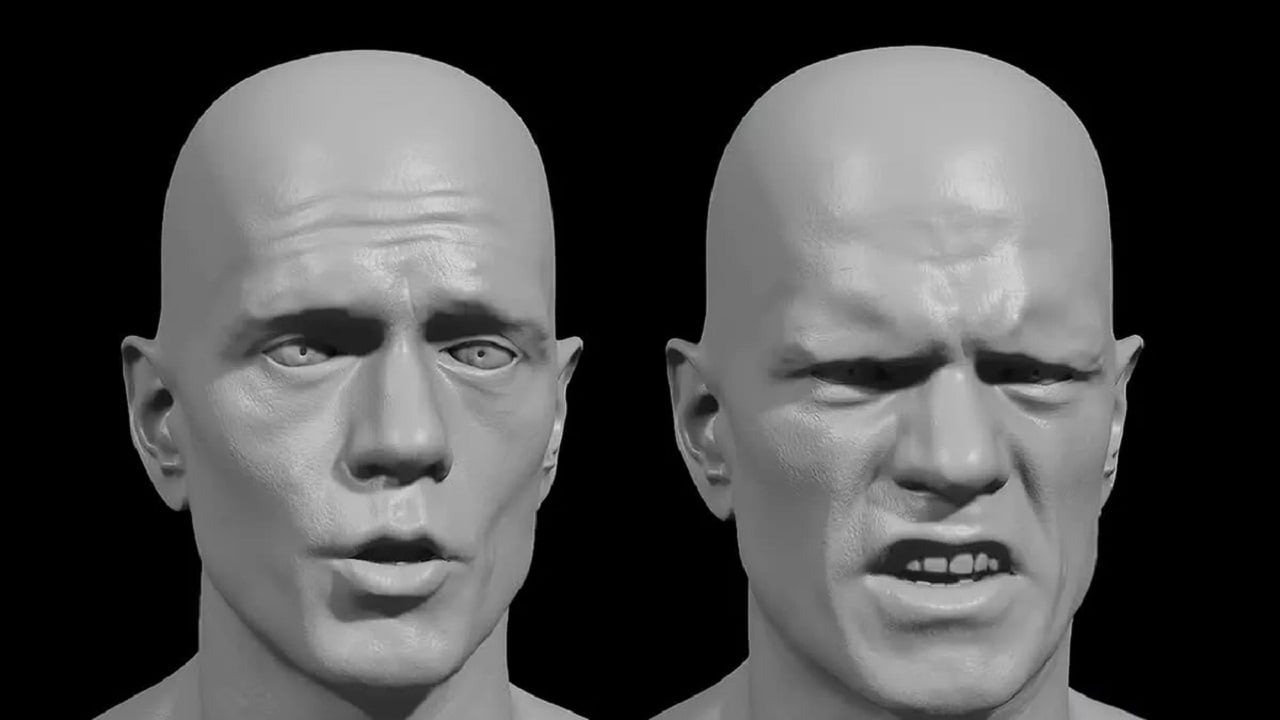

Technologia ta, nazwana Audio2Face, jest już od kilku miesięcy w fazie beta. Dopiero niedawno zwrócono na nią uwagę, pomimo jej potencjalnie rewolucyjnych implikacji dla twórców gier i animacji. Jak można się spodziewać po technologii, która jest napędzana przez AI i wciąż znajduje się w fazie beta, Audio2Face nie jest idealnym rozwiązaniem. Jakość dźwięku źródłowego będzie miała duży wpływ na jakość synchronizacji ruchów warg. Dodatkowo nie wydaje się też, by oprogramowanie dobrze radziło sobie z uchwyceniem emocji na twarzy. Bez względu na to, jakie zdanie rzucisz w domyślną postać Audio2Face noszącą imię Digital Mark, oczy, policzki, uszy i nos pozostają dość statyczne. Jest trochę ruchu, ale ogólnie jest on bardziej stonowany niż animacje ust, które są wyraźnie głównym celem Nvidii.

Zobacz też: Kanadyjskie studia Ubisoft zaczęły ostrą batalię o pracowników

Przekazywanie dokładnych emocji na twarzy postaci 3D jest tym, co wymaga lat pracy, a i po osiągnięciu mistrzostwa w tej dziedzinie jest dość żmudnym procesem. I tu właśnie Audio2Face może okazać się sporą pomocą. W zależności od tego jak łatwo to narzędzie zostanie zaimplementowane w systemie pracy danego dewelopera, może ono dostarczyć użyteczne, być może zastępcze animacje synchronizacji ruchu warg, pozwalając animatorom skupić się na innych częściach twarzy postaci.

Źródło: TechSpot