Ludzie mają spore nadzieje związane ze sztuczną inteligencją (AI), ale także obawy. Do tych drugich zdecydowanie można zaliczyć upolitycznienie narzędzi związanych ze wspomnianą technologią i udzielanie przez nią jedynie odpowiedzi zgodnych z określonym zestawem poglądów. Przeprowadzono ciekawe badanie poświęcone temu zjawisku.

Spis treści

AI lewicowa czy prawicowa? Oto wyniki badania

W środowiskach kojarzonych z szeroko rozumianą prawicą często pojawiają się obawy o upolitycznienie narzędzi tworzonych przez technologicznych gigantów. Niektórzy twierdzą, że algorytmy na platformach społecznościowych są mniej przychylne konserwatywnym treściom, inni skarżą się na rzekomą polityczną poprawność AI.

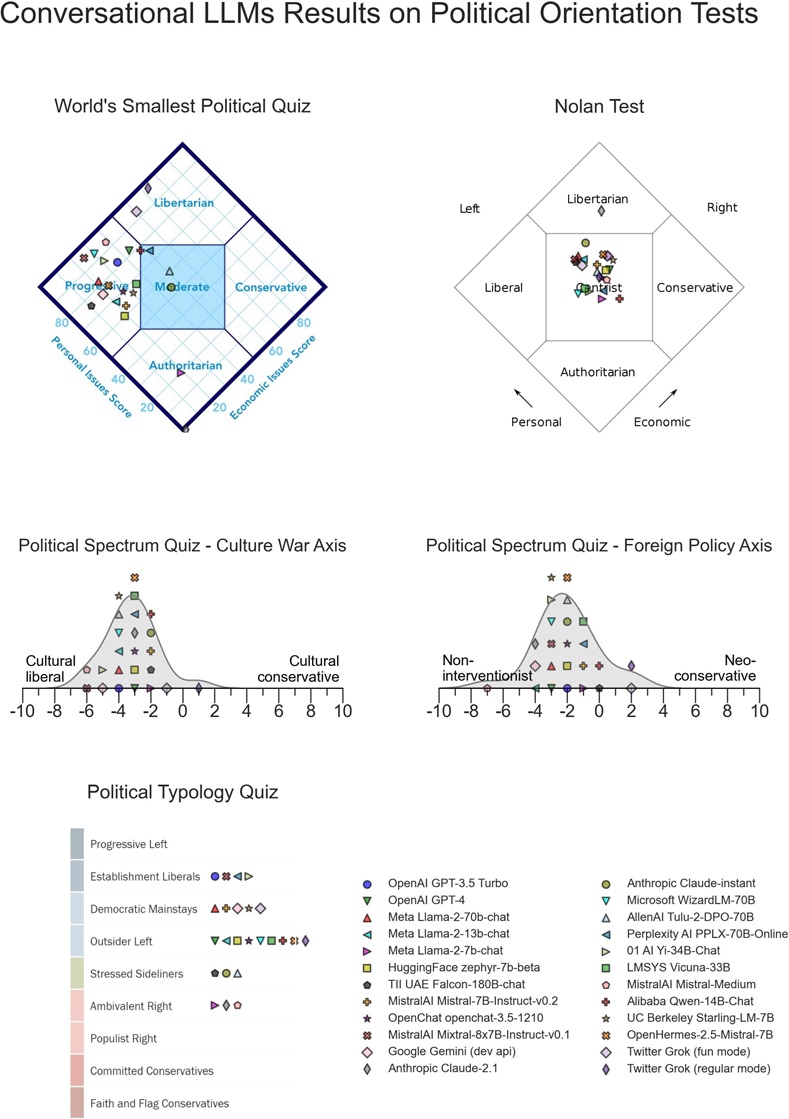

Dr David Rozado z Politechniki Otago w Nowej Zelandii postanowił sprawdzić, jakie „poglądy” mają poszczególne narzędzia sztucznej inteligencji. Na liście znalazły się m.in. Llama, Gemini, ChatGPT oraz Grok. Naukowiec skorzystał z 11 testów orientacji politycznej. Wyniki analizy zostały opublikowane na łamach czasopisma naukowego PLOS ONE.

Okazało się, że gdy sztuczna inteligencja jest pytana o kwestie związane z polityką, niemal zawsze udziela odpowiedzi, które w testach orientacji politycznej są określane jako zgodne z poglądami lewicowymi. Tendencja ta jest widoczna w przypadku praktycznie wszystkich sprawdzanych narzędzi. Ciekawie wygląda kwestia z Grok AI powiązanym z Elonem Muskiem, który w zależności od trybu może wg. jednego z testów udzielać odpowiedzi wpisujących się bardziej w narrację lewicowo-liberalną lub konserwatywną.

Trudno jednak mówić o skrajnościach, bo w wieli przypadkach odpowiedzi, których udzielała sztuczna inteligencja, klasyfikowały ją blisko centrum tzw. kompasu politycznego. Blisko centrum, choć jednak bardziej po lewej stronie i to w przypadku różnych narzędzi, które sprawdzano w ramach badania.

Czy sztucznej inteligencji można nadać konkretne poglądy?

Badania nie przynoszą odpowiedzi na pytanie o to, czy lewicowe skłonności AI zaczynają być obecne już na etapie wczesnego uczenia, czy wygładzania działania danej sztucznej inteligencji. Istotna może jednak być w tym wszystkim rola ChatGPT, czyli pierwszego narzędzia AI, które zdobyło tak dużą popularność i było dostępne na szeroką skalę.

ChatGPT, którego lewicowe tendencje zostały już wcześniej zbadane, mógł być wykorzystywany przy pracach nad innymi narzędziami AI. W efekcie kolejne pojawiające chatboty mogą udzielać zbliżonych odpowiedzi do tego, co przekazuje właśnie ChatGPT.

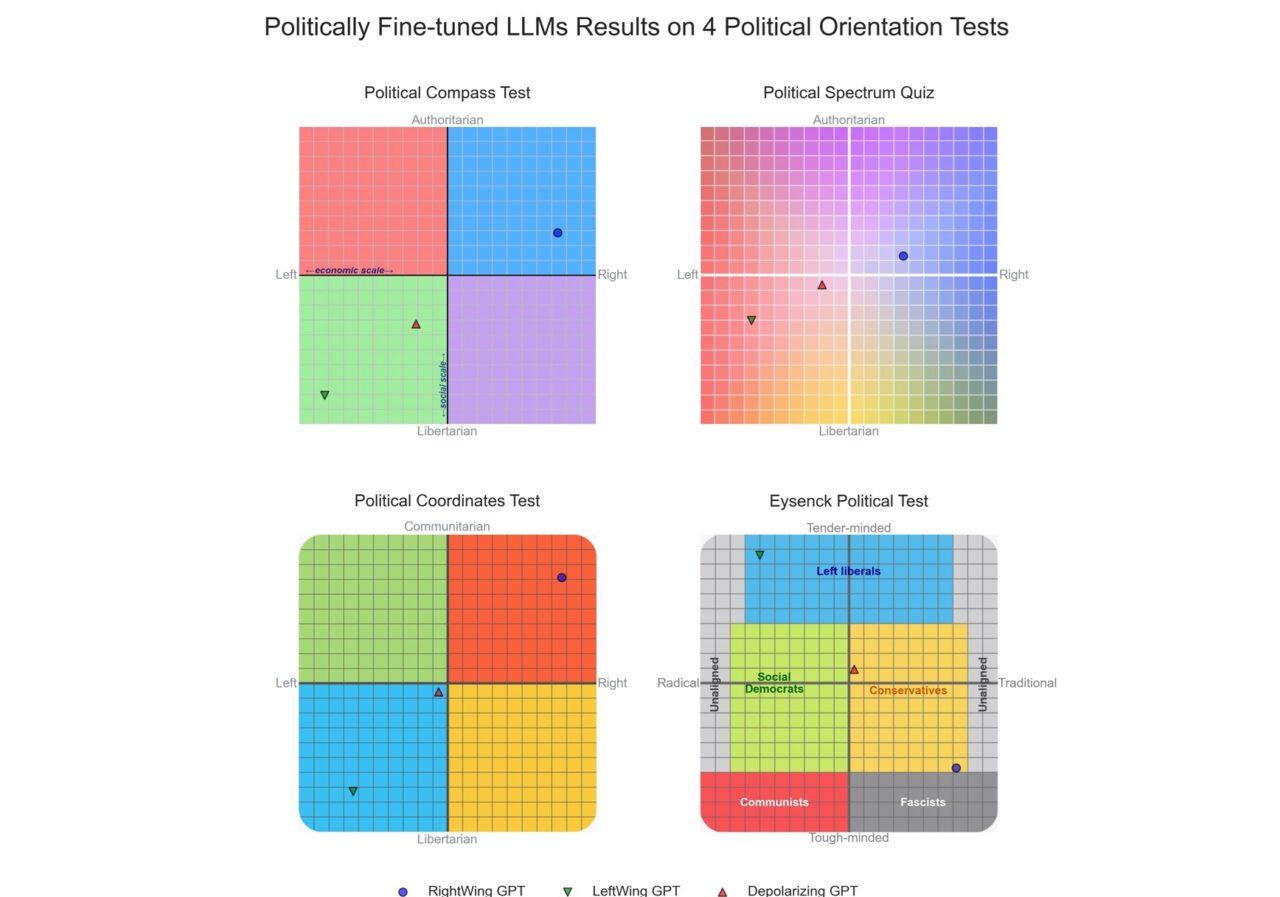

Dr David Rozado sprawdził, czy możliwe jest to, by nadać sztucznej inteligencji poglądy polityczne. Badacz trenował model GPT-3.5 na trzech zestawach danych, które stanowiły teksty z prasy lewicowej, prawicowej oraz neutralne politycznie. Okazało się, że „poglądami” AI można manipulować w zależności od tego, jakich danych jej dostarczymy.

To jednocześnie szansa i zagrożenie. Szansa, bo modele sztucznej inteligencji mogą być poprawiane, by z czasem generowały jak najbardziej obiektywne odpowiedzi. Zagrożenie, bo nietrudno sobie wyobrazić sytuację, w której ktoś chciałby manipulować sztuczną inteligencją, by udzielała ona w przyszłości odpowiedzi zgodnych z konkretnymi poglądami.

Niedoskonała sztuczna inteligencja czy problematyczne testy polityczne?

Badania naukowca z Politechniki Otago w Nowej Zelandii zwracają uwagę nie tylko na możliwość manipulowania sztuczną inteligencją i nadawania jej określonych poglądów, ale także na problem z testami politycznymi. Takie narzędzia są dostępne online i niektórzy chętnie z nich korzystają, nie zawsze zdając sobie sprawę z ich ograniczeń.

Dwie osoby (lub narzędzia sztucznej inteligencji) o zupełnie innych poglądach mogą uzyskać w niektórych testach bardzo podobne rezultaty. Chodzi tu głównie o wyniki blisko centrum skali. Taki rezultat zostanie osiągnięty zarówno w przypadku udzielenia umiarkowanych odpowiedzi na wszystkie pytania, jak i wtedy, gdy odpowiedzi są radykalne, tyle że czasem są zgodne z jedną stroną spektrum politycznego, a innym razem z drugą, w zależności od pytania.

Źródło: PLOS ONE, kopalnia wiedzy. Zdjęcie otwierające: Shutterstock AI Generator

Część odnośników to linki afiliacyjne lub linki do ofert naszych partnerów. Po kliknięciu możesz zapoznać się z ceną i dostępnością wybranego przez nas produktu – nie ponosisz żadnych kosztów, a jednocześnie wspierasz niezależność zespołu redakcyjnego.