Deepfake to wykorzystanie Sztucznej Inteligencji i technik uczenia maszynowego do kreowania fałszywego obrazu świata. Przy pomocy narzędzi tego typu można na przykład przerobić zdjęcie kobiety tak, aby była ona na nim naga. Już sam ten mechanizm otwiera olbrzymie pole do nadużyć i może zszargać opinię niejednej dziewczynie. Możliwe jest także generowanie wypowiedzi innych osób przez syntezator, który korzysta z ich głosu. I, mimo że te narzędzia są w pewnym stopniu niedoskonałe, to powoli stają się coraz lepsze.

Deepfake to poważne zagrożenie

Deepfake przenosi kłamstwo na zupełnie nowy poziom. Problemem więc staje się rozpoznawanie prawdy. Wyżej opisałem dwa obecnie możliwe przykłady. Jednak w przyszłości nie będzie można ufać, chociażby relacjom z jakichś wydarzeń. Możliwe będzie przedstawienie nagrania w formie dowodu zbrodni, która mogłaby nawet nie nieć miejsca.

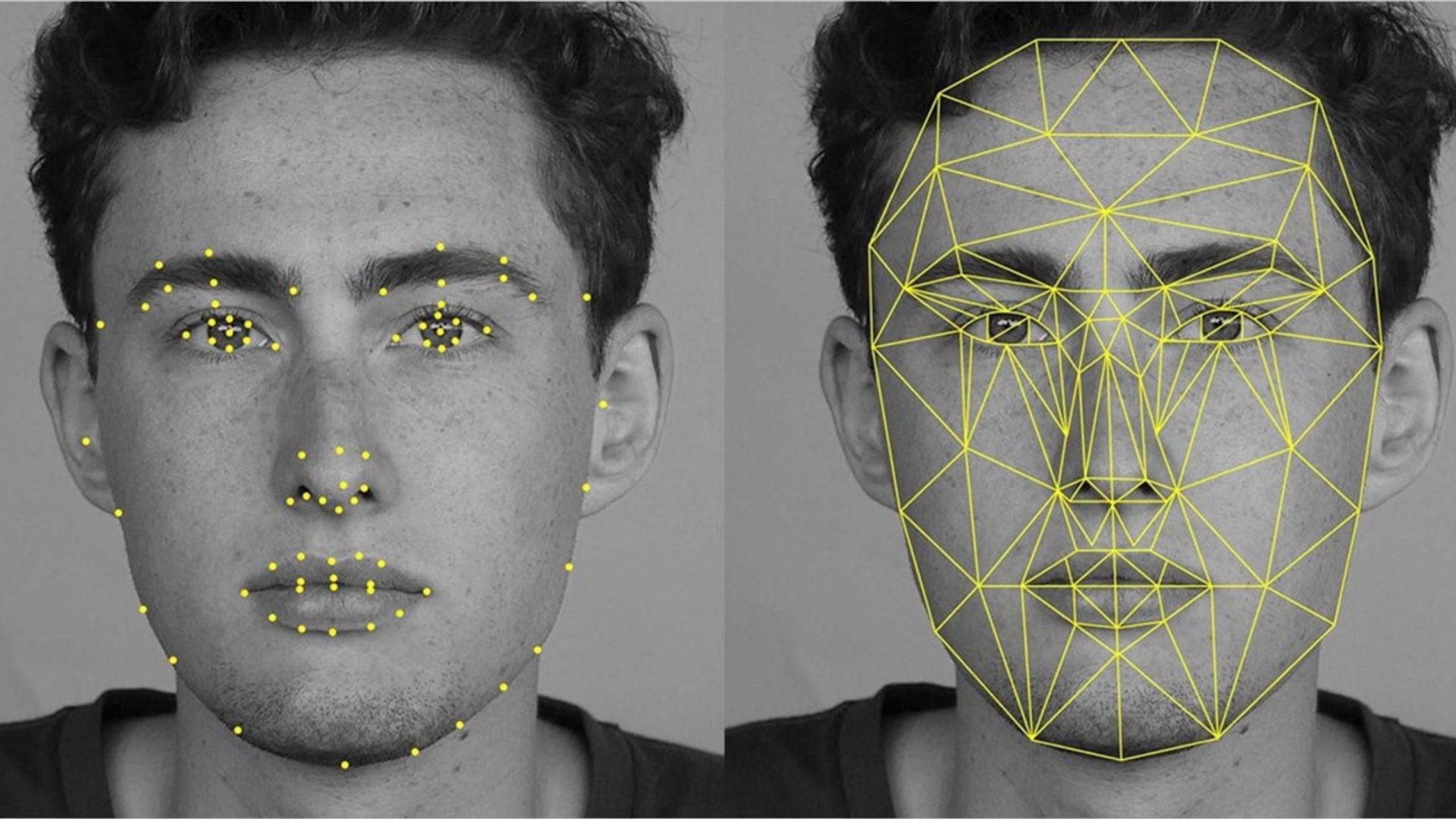

Analizujemy i łączymy coraz więcej danych, dzięki czemu można wytwarzać różnego rodzaju sztuczne dane. W Techmo zajmujemy się głównie syntezowaniem głosów, robiliśmy przymiarki takich komunikatów jak prezydent Obama mówiący w języku polskim. Tutaj jest bardzo duże pole do różnego rodzaju nadużyć. Łatwo wytworzyć komunikat audio znanej osoby i powiedzieć jej głosem coś, czego nigdy nie powiedziała. Wygenerowanie wywiadu z kimś, kto nie istnieje, nie jest w tej chwili żadnym problemem. Technologia deepfake potrzebuje danych i algorytmów. I obie te części w ostatnich latach nabrały zupełnie nowych wymiarów, są dużo większe bazy zdjęć, nagrań wideo czy audio. To jest bardzo szybko rosnąca branża. Są też różnego rodzaju algorytmy oparte na sieciach neuronowych, temu trendowi sprzyja też coraz silniejsza architektura komputerów, coraz większe możliwości przetwarzania danych.

– mówi agencji informacyjnej Newseria Innowacje dr hab. Bartosz Ziółko, prezes zarządu Techmo.

Zobacz też: Ciekawy projekt: Raspberry Pi jako kieszonsolka do strumieniowania gier z PC

Oczywiście można także wykorzystać ją do innych celów. W końcu lekcja fizyki przeprowadzona przez Newtona mogłaby być dla wielu osób znacznie bardziej interesująca, od nudnego wykładu.

Siła mediów jest duża, a fałszywe komunikaty mają silne oddziaływanie. Pod kątem reklamowym i kreowania światopoglądu jest duże pole do popisu, komercjalizowalność tego typu technik jest spora. Czasami łatwiej wygenerować nieprawdziwe treści, niż tworzyć prawdziwe, za którymi trzeba chodzić, analizować i odpowiednio przygotować. Są też inne zastosowania, jak np. generowanie wypowiedzi osób już nieżyjących. To mogą być zarówno osoby, które niedawno zmarły, a jest planowana kontynuacja serialu, czy jakiejś gry, mogą to być też komunikaty osób historycznych.

— Dodaje ekspert.

Jedno jest pewne: wraz z rozwojem deepfake potrzebujemy także narzędzi, które będą w stanie je wykryć. Inaczej poznanie prawdy stanie się o wiele trudniejsze, niż obecnie.

Źródło: Newseria